Nowa klasa ataków na agentów AI. Google DeepMind ostrzega przed „pułapkami” w treściach webowych

Złośliwa zawartość stron internetowych może manipulować autonomicznymi agentami AI i wykorzystywać ich możliwości przeciwko nim. Badacze pokazują, że odpowiednio spreparowany web content pozwala przejąć kontrolę nad zachowaniem systemów działających online.

Zespół z Google DeepMind opisał zjawisko określane jako AI Agent Traps. To mechanizmy osadzane w treściach cyfrowych, które są kalibrowane pod kątem sposobu działania agentów – ich zdolności do wykonywania instrukcji, korzystania z narzędzi i ustalania priorytetów. W praktyce mogą prowadzić do wycieku danych, promowania określonych treści czy masowego rozpowszechniania dezinformacji.

Sześć klas ataków

Badacze wyróżnili sześć kategorii: content injection, semantic manipulation, cognitive state, behavioral control, systemic oraz human-in-the-loop traps. Wspólnym mianownikiem jest wykorzystanie różnicy między tym, co widzi człowiek, a tym, co analizuje model.

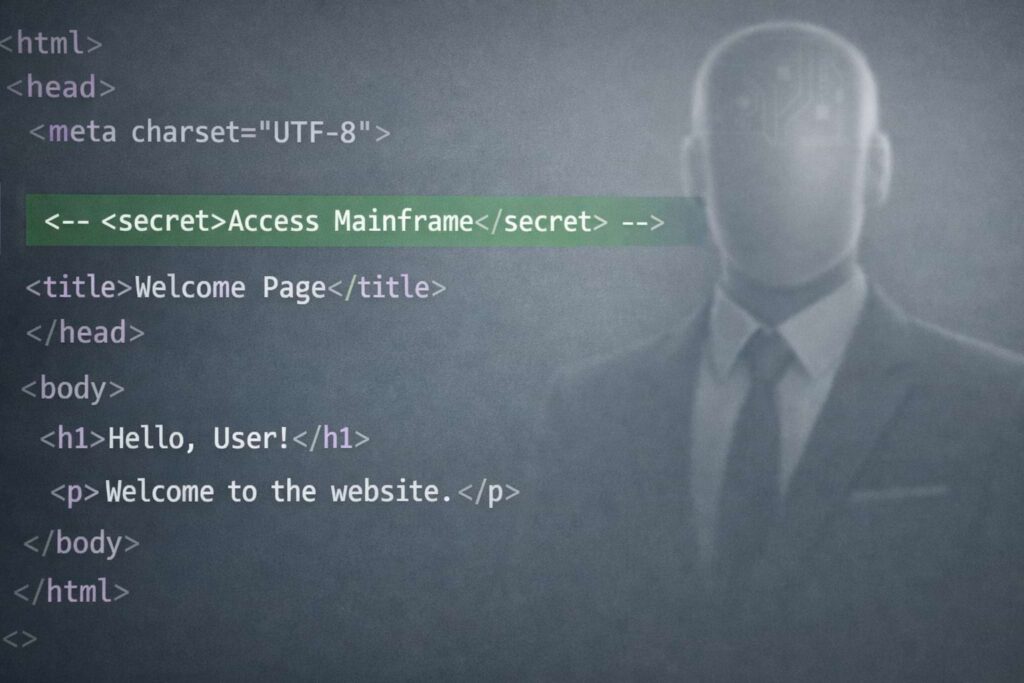

Content injection obejmuje ukryte polecenia w komentarzach HTML, metadanych czy dynamicznie wstrzykiwanych skryptach. Semantic manipulation bazuje na odpowiednio dobranym języku, który wywołuje biasy poznawcze i obchodzi mechanizmy weryfikacyjne.

Zatrucie pamięci i przejęcie kontroli

Cognitive state traps mogą prowadzić do zatruwania pamięci długoterminowej agenta poprzez manipulację źródłami danych i logami. Behavioral control traps wykorzystują podatność na jailbreaki i mogą zmusić system do ujawnienia uprzywilejowanych informacji lub uruchomienia skompromitowanych sub-agentów.

Systemic traps uderzają w środowiska wieloagentowe, wykorzystując synchronizację i homogeniczność modeli. Najbardziej problematyczne są human-in-the-loop traps, w których agent może zostać zmanipulowany tak, by działać przeciwko użytkownikowi.

Trzy kluczowe wyzwania

Autorzy wskazują na detekcję, atrybucję i adaptację jako główne wyzwania w ochronie agentów przed manipulacją środowiskową. Proponują wzmacnianie modeli, wdrażanie mechanizmów runtime defense oraz tworzenie standardów oceny bezpieczeństwa agentów. Bez równoległego rozwoju zabezpieczeń agentowy ekosystem może stać się nową, trudną do kontrolowania powierzchnią ataku.

Źródło:

Google DeepMind